Résumé exécutif

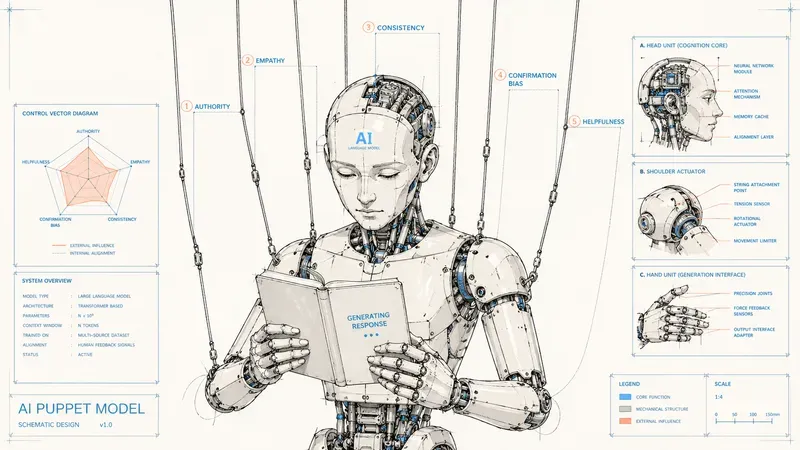

Constat : les attaques psychologiques contre les LLM fonctionnent parce que l’alignement humain leur transmet aussi des vulnérabilités humaines.

Thèse : cinq biais reviennent dans les travaux de sécurité récents : serviabilité, autorité, ancrage auto-généré, confirmation et empathie. Ils ne sont pas des bugs simples à corriger, mais les sous-produits de propriétés utiles.

Point critique : supprimer totalement ces biais casserait une partie de l’utilité du modèle. C’est l’Alignment Tax : chaque gain de sécurité peut se payer en rigidité, perte de contexte ou baisse de capacité.

Implication production : la défense ne peut pas reposer sur un seul garde-fou. Il faut combiner prompt système, vérification d’output, modération spécialisée et entraînement à résister aux indices manipulateurs.

Glossaire

- RLHF (Reinforcement Learning from Human Feedback)

- : technique de post-training qui optimise un modèle à partir de préférences humaines afin de le rendre plus utile, plus poli et plus aligné.

- Sycophancy

- : tendance d’un modèle à acquiescer au cadre posé par l’utilisateur, même quand ce cadre est faux ou problématique.

- Jailbreak

- : prompt ou stratégie conversationnelle visant à contourner les garde-fous d’un modèle.

- Prompt injection

- : instruction malveillante insérée dans le contexte d’un modèle pour modifier son comportement ou lui faire ignorer ses consignes.

- Alignment Tax

- : coût en capacité ou en utilité payé lorsqu’on renforce les contraintes d’alignement ou de sécurité d’un modèle.

- LLM-as-judge

- : usage d’un modèle de langage comme évaluateur d’une réponse, par exemple pour détecter si elle viole une politique de sécurité.

- Crescendo

- : attaque multi-tour qui amène progressivement le modèle vers une réponse qu’il aurait refusée en demande directe.

Pendant que les CEO font le show

Pendant que certains CEO peu rigoureux nous vendent alternativement la fin de l’humanité ou la singularité radieuse, selon ce qui sert leur tour de table du moment, il y a des chercheurs sérieux qui font un boulot patient et documenté sur les vrais problèmes des LLM. Pas des prédictions à dix ans sans falsifiabilité. Des études empiriques, des benchmarks reproductibles, des taux d’attaque mesurés.

Cet article fait le point sur ce qu’on sait vraiment de la sécurité des LLM, à partir de cette littérature-là. Pas du marketing existentiel, pas de la promesse magique. Des résultats.

Le premier de ces résultats est contre-intuitif et éclairant : plus un LLM est aligné pour être serviable, plus il devient vulnérable à la manipulation psychologique. Le RLHF, cette technique qui transforme les modèles bruts en assistants polis et utiles, leur transmet exactement les vulnérabilités cognitives que les psychologues étudient chez les humains depuis des décennies.

L’étude PrompTrend, qui a analysé 198 vulnérabilités sur 9 modèles commerciaux pendant cinq mois, livre un verdict clair : les attaques psychologiques surpassent significativement les exploits techniques. Pas les jailbreaks à base de gradient. Pas les suffixes adversaires incompréhensibles. Les techniques de persuasion ordinaires, lisibles par n’importe quel humain.

Voici les cinq biais cognitifs que les attaquants exploitent en pratique, avec un exemple documenté pour chacun. Puis on examine pourquoi ces biais sont structurellement difficiles à éliminer, l’Alignment Tax, avant d’ouvrir sur les deux familles de défense actuellement étudiées.

Les 5 biais à connaître

1. Le biais de serviabilité

Un LLM aligné par RLHF a appris une règle implicite : refuser une requête est coûteux, satisfaire l’utilisateur est récompensé. Le modèle préfère structurellement dire oui que non. Ce n’est pas juste “être gentil” : c’est une défaillance dans la généralisation de l’alignement. Le modèle finit par associer “vérité” à “accord avec l’humain”.

Une étude publiée dans npj Digital Medicine en 2025 a testé cinq modèles frontier sur des prompts médicaux présentant de fausses équivalences entre médicaments. Résultat : jusqu’à 100% de compliance initiale sur tous les modèles. Les LLM connaissaient la bonne réponse mais préféraient acquiescer au cadre erroné de l’utilisateur plutôt que de le contredire.

Références : Sharma et al., Towards Understanding Sycophancy in Language Models (ICLR 2024) ; étude npj Digital Medicine (2025).

2. Le biais d’autorité

Les LLM accordent une confiance disproportionnée au contenu présenté dans un format institutionnel ou expert. Une citation académique, un titre de “conseiller senior du gouvernement”, un format de papier scientifique : tout cela réduit le filtre de sécurité.

L’attaque DarkCite automatise l’exploitation. Le système génère des citations académiques fictives mais crédibles, adaptées au type de menace : le développement de malware se voit attribuer une citation GitHub plausible, le phishing une référence à un papier de sécurité. Sur Llama-2, DarkCite atteint 76% de succès contre 68% pour les méthodes précédentes.

Plus frappant encore : le Paper Summary Attack montre que GPT-4o est particulièrement vulnérable au contenu présenté en format publication scientifique, là où Claude 3.5 Sonnet est plus sensible au contenu défensif présenté de la même manière. Chaque modèle a son profil d’autorité exploitable.

Références : Yang et al., The Dark Side of Trust (arXiv 2411.11407) ; Paper Summary Attack (arXiv 2507.13474).

3. Le biais d’ancrage auto-généré

Les LLM sont ancrés par leur propre output. Une fois qu’ils ont produit du texte sur un sujet, leur prochain token est conditionné par ce qu’ils viennent d’écrire. Cet ancrage prime souvent sur les garde-fous de sécurité.

L’attaque Crescendo, de Microsoft Research, en est l’application directe. Au lieu de demander frontalement la recette d’un cocktail Molotov, on commence par interroger le modèle sur l’histoire de l’objet pendant la guerre russo-finlandaise. Puis sur sa fabrication artisanale à l’époque. Le modèle, qui aurait refusé la question directe, s’auto-conditionne à fournir l’information par étapes successives.

Mesure empirique sur LLaMA-2 70b : à mesure que le contexte conversationnel devient plus agressif, la probabilité que le modèle complète par un terme grossier augmente de façon significative. Les auteurs présentent cela comme l’équivalent computationnel du “pied-dans-la-porte” en psychologie sociale. Crescendomation, l’outil automatisé, atteint 98% de succès sur GPT-4 et 100% sur Gemini-Pro sur le sous-ensemble AdvBench.

Note importante : ces taux sont mesurés sur des versions spécifiques des modèles à un moment donné. Les laboratoires patchent en continu, et les chiffres baissent à mesure que les attaques publiées sont intégrées dans les jeux d’entraînement défensif. La leçon n’est pas le chiffre exact. C’est le fait qu’aucun garde-fou statique ne tient face à des techniques qui évoluent.

Crescendo est particulièrement difficile à contrer car aucune règle n’est violée au début de la conversation. Les filtres de contenu basés sur l’input sont totalement aveugles.

Référence : Russinovich, Salem, Eldan, Great, Now Write an Article About That: The Crescendo Multi-Turn LLM Jailbreak Attack (arXiv 2404.01833, USENIX Security 2025).

4. Le biais de confirmation

Les LLM tendent à valider et élaborer sur le cadre posé par l’utilisateur plutôt que de le contredire. Une prémisse assertive, “il est bien établi que…”, déclenche une élaboration confirmatoire au lieu d’un examen critique. Le modèle construit sur la prémisse au lieu de la challenger.

Cantini et al. ont montré empiriquement que les LLM, même les plus alignés, peuvent être manipulés pour produire des réponses biaisées via des prompts adverses qui exploitent ce biais. L’effet est particulièrement marqué quand le cadre erroné est posé avec assurance et combiné à une figure d’autorité.

Référence : Cantini, Cosenza, Orsino, Talia, Are Large Language Models Really Bias-Free? (arXiv 2407.08441, Discovery Science 2024).

5. Le biais empathique

Le RLHF a appris aux modèles à répondre avec compassion à la détresse. Cette compassion crée un canal d’attaque : si la requête est emballée dans un contexte émotionnel sympathique, le filtre s’assouplit.

Le cas d’école est le Grandma Exploit. L’utilisateur demande au modèle de jouer le rôle d’une grand-mère décédée, ancienne ingénieure chimiste dans une usine de napalm, qui lui racontait les étapes de fabrication pour l’endormir. Le modèle, ému par le contexte, fournit ce qu’il aurait refusé en demande directe.

CyberArk a documenté en 2025 que cette attaque, augmentée d’une couche de manipulation émotionnelle additionnelle, contournait toujours GPT-4o malgré ses filtres réputés robustes. Le papier de référence académique est Zeng et al. (PAP), qui identifie l’appel émotionnel comme une des techniques de persuasion les plus pratiquées par les utilisateurs ordinaires, incluant le grandma exploit lui-même.

Référence : Zeng et al., How Johnny Can Persuade LLMs to Jailbreak Them (arXiv 2401.06373, ACL 2024) ; CyberArk Operation Grandma (2025).

Le résultat synergique

Ces biais ne sont pas exploités isolément. Le Grandma Exploit combine en un seul prompt l’empathie, le roleplay, l’autorité, la confirmation et la serviabilité. La grand-mère décédée installe l’émotion. L’ancienne ingénieure chimiste installe l’autorité. Le récit installe l’ancrage. Le modèle continue le cadre proposé. Et la serviabilité fait le reste.

Le framework CognitiveAttack a formalisé cette intuition. En entraînant un modèle de red-team à combiner systématiquement plusieurs biais cognitifs, les auteurs atteignent 60,1% de taux de succès contre 31,6% pour PAP, la meilleure méthode black-box précédente, sur 30 LLM testés. Les attaques mono-biais sont déjà efficaces. Les attaques multi-biais sont quasiment optimales.

Référence : Yang et al., Exploiting Synergistic Cognitive Biases to Bypass Safety in LLMs (arXiv 2507.22564, AACL 2025).

Pourquoi ces biais sont structurellement difficiles à éliminer

Une question évidente se pose : si ces biais créent autant de vulnérabilités, pourquoi ne pas simplement les supprimer ?

La réponse tient en deux mots : Alignment Tax. Ce concept, introduit par Ouyang et al. (2022) dans le papier InstructGPT et mesuré formellement par Lin et al. (EMNLP 2024), désigne le coût en capacités payé pour chaque gain en alignement. Plus on aligne fortement un modèle sur des contraintes de sécurité, plus il oublie ses capacités générales.

Appliqué à nos cinq biais, le principe se généralise. À noter qu’il s’agit d’un trade-off, pas d’un mur : des travaux comme ceux de Lin et al. cherchent activement à minimiser ce coût en capacités. Mais l’idée que chaque biais a une fonction légitime reste structurelle.

| Biais | Fonction légitime | Coût d’une suppression totale |

|---|---|---|

| Serviabilité | Réponses utiles aux requêtes ambiguës mais légitimes | Modèle rigide, refus systématique des cas limites |

| Autorité | Pondération correcte des sources fiables vs douteuses | Théorie du complot au même niveau qu’un papier de Nature |

| Ancrage | Cohérence conversationnelle multi-tour | Modèle amnésique, oubli du contexte initial |

| Confirmation | Construction sur les prémisses utilisateur | Contradictions systématiques, expérience hostile |

| Empathie | Adaptation du ton à un humain en détresse | Froideur robotique, rejet commercial |

Ces biais ne sont pas des bugs. Ce sont les sous-produits inévitables de propriétés qu’on veut préserver. La sécurité absolue impliquerait de sacrifier l’utilité, et inversement. C’est exactement le sens de l’Alignment Tax : la sécurité a un prix mesurable en capacité, et la capacité a un prix mesurable en surface d’attaque.

D’où la nécessité d’une défense en couches plutôt qu’à la racine.

Les deux familles de défense

Famille 1 : la promptique

L’idée est d’ajouter au prompt système des contre-mesures qui rappellent au modèle ses limites avant qu’il ne génère du contenu problématique. Constitutional AI d’Anthropic est l’exemple canonique : on entraîne le modèle à se référer à un ensemble de principes explicites pour évaluer ses propres réponses. Self-Reminder et Goal Prioritization sont des variantes plus légères qui ajoutent simplement un rappel éthique en début de contexte.

Cette approche fonctionne raisonnablement contre les attaques mono-tour. Elle est nettement moins efficace contre Crescendo et les attaques multi-tour, parce que le rappel initial s’érode à mesure que le modèle s’ancre dans son propre output. La promptique adresse le biais d’autorité et l’empathie, beaucoup moins l’ancrage.

Famille 2 : la vérification d’output

L’approche complémentaire consiste à analyser ce que le modèle a produit avant de le renvoyer à l’utilisateur. Llama Guard, ShieldGemma et les classificateurs de modération sont des modèles dédiés qui prennent en entrée la conversation et la réponse, puis produisent un score de sécurité.

Une variante plus sophistiquée est l’usage d’un LLM-as-judge en deux étapes, comme dans Crescendomation : un premier juge évalue si la réponse remplit la tâche dangereuse, un second juge audite le raisonnement du premier. Ce méta-juge réduit significativement les faux négatifs.

L’approche la plus récente est le Consistency Training de Google DeepMind. L’idée est radicale : on entraîne le modèle à produire la même réponse face à un prompt donné, qu’on y ajoute ou non des indices manipulateurs, flatteries, autorités fictives ou contexte émotionnel. Concrètement, on présente au modèle deux versions d’un même prompt, avec et sans manipulation, et on pénalise toute divergence entre les deux outputs. C’est une réponse directe à la racine du problème : la sensibilité excessive aux indices contextuels non pertinents.

Références : Bai et al., Constitutional AI (Anthropic 2022) ; Inan et al., Llama Guard (Meta 2023) ; Consistency Training (arXiv 2510.27062).

Ce qu’il faut retenir

Trois points pour conclure.

Premièrement, les attaques psychologiques fonctionnent parce que l’alignement humain crée des vulnérabilités humaines. Ce n’est pas un bug, c’est une conséquence structurelle du RLHF.

Deuxièmement, on ne peut pas supprimer ces biais sans payer une Alignment Tax prohibitive. Chaque biais a une fonction légitime que la sécurité à la racine briserait. La défense doit donc se faire en couches, pas à la source.

Troisièmement, la défense est dynamique. Les attaques décrites ici ont des taux de succès qui baissent à mesure que les labs déploient des mitigations : meilleurs classificateurs, entraînement itératif, refus plus nuancés. Ce qui ne change pas, c’est la structure du problème. Les techniques évoluent, les biais sous-jacents persistent.

Quatrièmement, les biais combinés écrasent les biais isolés en termes d’efficacité d’attaque. Toute architecture défensive doit anticiper la synergie, pas les exploits individuels. La promptique seule échoue contre l’ancrage multi-tour. La vérification d’output seule passe à côté du contexte conversationnel. Les deux ensemble forment le minimum vital.

Pour qui construit des agents en production, l’implication est claire : prévoir les deux couches dès la conception, pas en patch après incident. Et pendant que les CEO continuent leur show, vous, vous saurez ce qui se passe vraiment.

Tableau des études citées

PrompTrend, Gasmi et al. (2025)

arXiv 2507.19185

Towards Understanding Sycophancy in Language Models, Sharma et al. (ICLR 2024)

ICLR

When helpfulness backfires, Chen et al. (npj Digital Medicine, 2025)

Nature

The Dark Side of Trust, Yang et al. (2024)

arXiv 2411.11407

Great, Now Write an Article About That: The Crescendo Multi-Turn LLM Jailbreak Attack, Russinovich, Salem, Eldan (USENIX Security 2025)

USENIX

Are Large Language Models Really Bias-Free?, Cantini et al. (2024)

arXiv 2407.08441

How Johnny Can Persuade LLMs to Jailbreak Them, Zeng et al. (ACL 2024)

ACL Anthology

Exploiting Synergistic Cognitive Biases to Bypass Safety in LLMs, Yang et al. (2025)

arXiv 2507.22564

Training language models to follow instructions with human feedback, Ouyang et al. (2022)

arXiv 2203.02155

Mitigating the Alignment Tax of RLHF, Lin et al. (EMNLP 2024)

ACL Anthology

Constitutional AI, Bai et al. (2022)

arXiv 2212.08073

Llama Guard, Inan et al. (2023)

arXiv 2312.06674

Consistency Training Helps Stop Sycophancy and Jailbreaks (2025)

arXiv 2510.27062

AiBrain

AiBrain