Lecture critique du papier HyperAgents (Zhang et al., mars 2026) arXiv : https://arxiv.org/pdf/2603.19461

Résumé exécutif

Constat : Le papier HyperAgents peut donner l’impression de proposer une nouvelle architecture générale d’agents auto-améliorables. En réalité, sa valeur la plus forte n’est pas dans son usage direct en production.

Idée centrale : Il faut lire HyperAgents comme une machine d’exploration. Le système sert à faire émerger, par essais successifs, des mécanismes utiles d’agent engineering que l’on pourra ensuite réimplémenter dans des systèmes plus simples, plus stables et plus auditables.

Pourquoi ce n’est pas une architecture de prod : Une boucle de self-modification continue reste coûteuse, difficile à auditer et compliquée à défendre dans des contextes industriels où la lisibilité, la robustesse et la maîtrise des coûts sont prioritaires.

Ce que le papier apporte vraiment : Il montre que des mécanismes réutilisables peuvent émerger sans avoir été explicitement programmés, comme de la mémoire persistante, du tracking de performance, des pipelines d’évaluation structurés ou des stratégies tenant compte du budget de calcul.

Lecture pratique : Le bon workflow n’est pas “déployer HyperAgents tel quel”, mais plutôt :

- explorer dans un cadre borné,

- extraire les patterns stables qui améliorent les résultats,

- figer ces patterns dans un agent classique de production.

Glossaire

- Hyperagent

- programme contenant à la fois un agent de tâche et un méta-agent chargé de produire les modifications suivantes.

- Task agent

- partie du système qui exécute directement la tâche visée, par exemple résoudre un problème, noter une preuve ou rédiger une review.

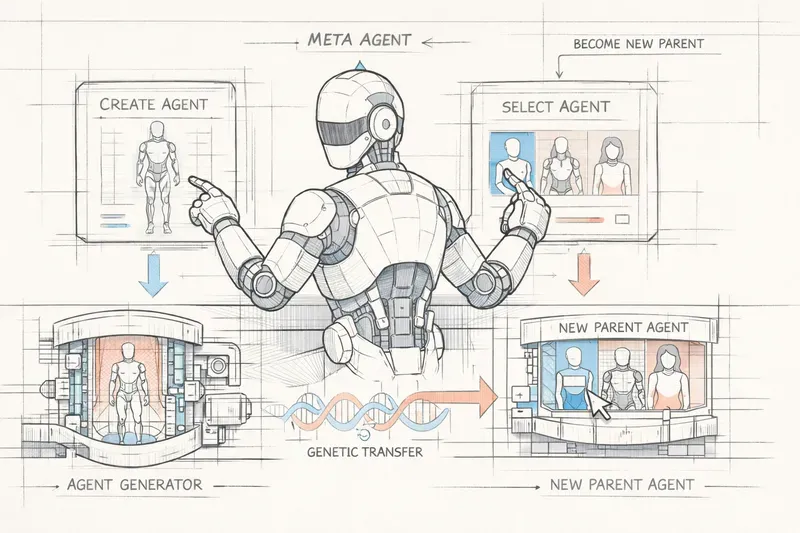

- Meta agent

- composant qui inspecte le système existant, propose des changements et génère la prochaine version de l’agent.

- Self-modification

- capacité d’un système à modifier son propre programme ou sa propre stratégie d’exécution.

- Metacognitive self-modification

- capacité d’un système à améliorer non seulement sa façon de résoudre une tâche, mais aussi sa façon de produire ses propres améliorations.

- Archive

- ensemble des variantes d’agents déjà générées et conservées au fil des itérations, servant à maintenir diversité et continuité dans l’exploration.

- Open-ended exploration

- processus d’amélioration sans objectif de forme prédéfini, où le système explore librement des variantes pouvant mener à des mécanismes inattendus.

- Transfer inter-domaines

- capacité à réutiliser dans un nouveau domaine des mécanismes appris dans d’autres domaines.

- Pattern d’agent engineering

- mécanisme réutilisable dans la conception d’agents, comme une mémoire persistante, un tracker de performance ou un pipeline d’évaluation en plusieurs étapes.

- Artifact figé

- version stabilisée et réimplémentée d’un mécanisme découvert lors de l’exploration, destinée à un usage de production.

Un papier très prometteur vient de sortir : HyperAgents.

À première vue, on pourrait se dire : ça y est, les agents qui s’auto-améliorent sont là. À l’inverse, on pourrait aussi balayer ça d’un revers de main : encore une démo de labo peu utile en pratique.

Mon avis est différent.

Je ne crois pas que ce papier soit surtout intéressant comme architecture cible de production. Je le trouve bien plus intéressant comme machine d’exploration : une façon de faire émerger des patterns d’agent engineering qu’on pourra ensuite figer dans des systèmes plus robustes.

C’est cette distinction que je veux développer ici, avec les yeux de quelqu’un qui passe autant de temps à faire tourner des agents en prod qu’à lire des papiers.

Ce que le papier propose

Le problème de départ

Le Darwin Godel Machine (DGM), le prédécesseur direct, montrait déjà qu’un agent de code pouvait s’auto-améliorer de façon ouverte : il génère des variantes de lui-même, les évalue sur un benchmark, archive les meilleures, et les utilise comme point de départ pour la génération suivante. Ça fonctionne bien en coding, parce que la tâche (écrire du code) et la capacité d’auto-modification (modifier du code) sont alignées : mieux coder, c’est aussi mieux se modifier.

Hors du domaine du code, cet alignement disparaît. Un agent qui s’améliore à noter des preuves mathématiques ne devient pas automatiquement meilleur pour modifier son propre code source. Le mécanisme d’instruction-generation du DGM, c’est-à-dire la procédure qui décide quoi améliorer, reste fixe et artisanal. C’est le goulot d’étranglement.

La solution proposée : rendre le méta-agent modifiable

Les auteurs introduisent le concept d’hyperagent : un programme unique qui contient à la fois un task agent et un meta agent. La clé, c’est que le meta agent est lui-même dans le programme modifiable. Il peut donc se réécrire.

Concrètement, le système peut améliorer non seulement comment il résout une tâche, mais aussi comment il génère ses propres améliorations. Les auteurs appellent cela la metacognitive self-modification.

La boucle en pratique

Le système démarre avec un hyperagent volontairement minimaliste : le task agent fait un seul appel LLM, et le meta agent reçoit simplement l’instruction “modifie ce que tu veux dans le dépôt”.

À chaque itération :

- un hyperagent parent est sélectionné dans l’archive, proportionnellement à ses performances,

- son meta agent s’exécute, inspecte le dépôt et les résultats passés, puis génère une version modifiée,

- le nouvel hyperagent est évalué empiriquement sur les tâches du domaine,

- s’il compile et produit un résultat valide, il est ajouté à l’archive.

L’archive grandit avec une diversité de variantes, certaines plus performantes, d’autres simplement utiles comme tremplins intermédiaires. La sélection reste biaisée vers les agents performants qui ont peu d’enfants, afin de préserver l’exploration.

Les résultats

Les expériences couvrent quatre domaines : le coding (Polyglot), la peer review de papiers ML, le reward design en robotique (Genesis simulator) et la notation de preuves IMO.

Sur chaque domaine, le DGM-H améliore significativement les performances par rapport à l’agent initial et aux baselines sans auto-amélioration ou sans exploration ouverte.

Le résultat le plus frappant est celui du transfert inter-domaines : un hyperagent entraîné sur paper review et robotics est transféré sans modification vers IMO grading, un domaine pourtant très différent. Avec 50 itérations supplémentaires depuis cet agent transféré, le système atteint un gain de 0.630, là où l’agent initial et les agents DGM-custom transférés restent à 0.0.

Pourquoi je ne le lis pas comme une architecture de prod

Pour des usages réels, la fiabilité repose sur des systèmes plus figés : lisibles, prévisibles, auditables. Une boucle d’auto-modification continue en production est difficilement défendable comme architecture cible.

Il y a aussi un argument économique direct. Les auteurs rapportent, dans l’appendix D.2, des dizaines de millions de tokens à l’échelle d’un programme expérimental complet : self-modification plus évaluation, sur 100 itérations, avec 5 runs répétés par condition. Ce n’est pas viable comme boucle continue pour la majorité des cas d’usage industriels.

Mais ce serait une erreur de s’arrêter là.

Ce que DGM-H fait réellement émerger

Ce que le système produit au fil des générations est, à mes yeux, la partie la plus précieuse du papier.

Le papier montre une montée en structure progressive, depuis des ajustements superficiels de prompt jusqu’à de véritables mécanismes réutilisables (appendix E.3) :

- PerformanceTracker : moving average, trend detection, comparaison inter-générations

- Mémoire persistante : synthèse d’insights, hypothèses causales, plans prospectifs cross-itérations

- Détection automatique de biais : identification du collapse de classification, correction par seuils

- Pipelines d’évaluation structurés : deux stages explicites, checklists, arbres de décision

- Compute-aware planning : adaptation de la stratégie selon le budget restant

Aucun de ces mécanismes n’a été explicitement demandé. Le système les a découverts en cherchant à mieux performer. Et c’est précisément leur valeur : ils sont le résultat d’une exploration coûteuse, mais ils peuvent ensuite être figés à coût quasi nul dans un système classique.

Le dynamique sert à explorer. Le figé sert à fiabiliser.

Ce que les résultats de transfert confirment

Les expériences de transfert vont exactement dans ce sens.

Ce qui survit d’un domaine à l’autre, ce ne sont pas des connaissances métier. Ce sont des mécanismes méta : mémoire, tracking, procédures d’auto-modification plus structurées.

BetterGrader ne découvre pas “qu’il faut des rubrics” en général. Il découvre une calibration plus adaptée au domaine IMO, avec une distribution de scores qui colle mieux aux annotations humaines que ProofAutoGrader. On voit donc émerger une spécialisation qui peut ensuite être cristallisée.

Le DGM custom, c’est-à-dire la version avec instruction-generation manuelle par domaine, reste compétitif sur les résultats. Mais il nécessite de l’ingénierie humaine à chaque nouveau domaine. Le DGM-H produit cette spécialisation sans intervention explicite. La différence est donc autant une différence de coût d’engineering qu’une différence de performance.

Ce que j’en ferais concrètement

Lu comme machine d’exploration, le DGM-H suggère un workflow en trois temps :

- Explorer : lancer une campagne DGM-H bornée, avec budget tokens défini, domaine précis et sandbox strict, pour faire émerger des patterns d’agent engineering.

- Extraire : identifier les mécanismes qui ont survécu à plusieurs générations et amélioré les résultats de façon stable.

- Figer : réimplémenter ces mécanismes dans un agent classique, statique et auditable.

Ce workflow a un coût d’exploration justifiable comme investissement R&D, tout en produisant un artefact de production maintenable.

La vraie question pratique laissée ouverte par le papier, et celle qui m’intéresse le plus, concerne le monitoring : comment détecter qu’un artefact figé dérive dans le temps, et à quel moment relancer une campagne d’exploration ?

Le déplacement de métier

C’est peut-être la conclusion la plus importante.

Si ce type d’approche se généralise, le travail de l’ingénieur en agentique ressemblera moins à “écrire les comportements” qu’à :

- définir le cadre d’exploration et les contraintes,

- concevoir des critères d’évaluation robustes,

- décider quand un résultat mérite d’être cristallisé,

- assurer le monitoring de l’artefact figé dans le temps.

Le papier ne formule pas explicitement cette conclusion. Pourtant, c’est probablement la plus actionnable pour quiconque construit des systèmes agentiques aujourd’hui.

On explore pour apprendre, on fige pour déployer.

AiBrain

AiBrain