Résumé exécutif

Constat : DeepSeek ne se distingue pas seulement par ses performances, mais par sa capacité à transformer des idées d’architecture en composants de production.

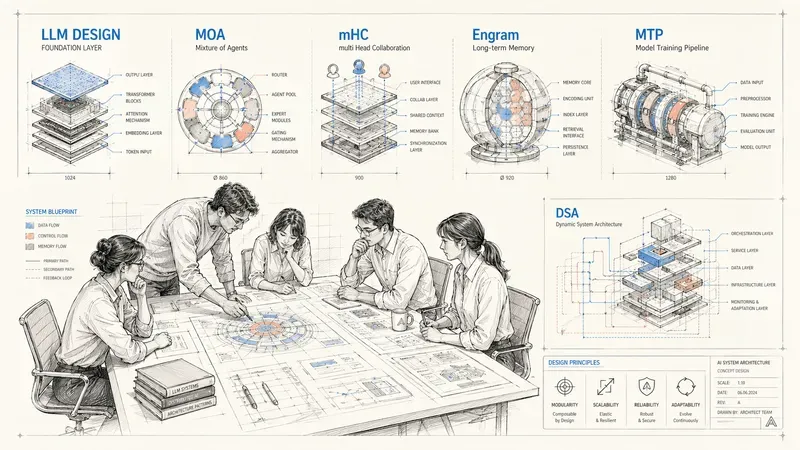

Thèse : V4 m’intéresse moins comme futur score de benchmark que comme possible synthèse d’un programme architectural cohérent : MoE pour le compute, MLA et DSA pour l’attention, mHC pour la profondeur, Engram pour la mémoire.

Point critique : ces gains rendent les modèles plus efficaces, mais déplacent aussi la valeur vers une stack d’exécution plus spécialisée, plus complexe à mettre en œuvre et donc moins accessible.

Ce qu’il faut regarder : le technical report de V4 dira davantage que les benchmarks. La vraie question est de savoir si DeepSeek change la manière de construire les prochains LLM, pas seulement s’il court plus vite.

Glossaire

- MoE (Mixture of Experts)

- : architecture où seule une partie des paramètres est activée pour chaque token, afin d’augmenter la capacité totale sans payer tout le coût de calcul à chaque inférence.

- MLA (Multi-head Latent Attention)

- : variante d’attention qui compresse les clés et valeurs dans un espace latent pour réduire fortement le KV cache.

- KV cache

- : mémoire utilisée en inférence pour stocker les clés et valeurs déjà calculées par l’attention, afin d’éviter de les recalculer à chaque token.

- DSA (DeepSeek Sparse Attention)

- : mécanisme d’attention sparse qui sélectionne dynamiquement les tokens importants, au lieu d’appliquer une attention dense partout.

- mHC (Manifold-Constrained Hyper-Connections)

- : approche multi-chemins qui contraint le mélange des flux pour stabiliser le signal et le gradient dans des modèles très profonds.

- Engram

- : mémoire statique conditionnelle qui permet au modèle de retrouver certains motifs ou faits par lookup rapide, au lieu de mobiliser tout le réseau neuronal.

- Gradient

- : signal mathématique qui indique comment modifier les poids du modèle pendant l’entraînement.

- Backpropagation

- : étape où le gradient remonte à travers les couches du réseau pour corriger les poids après une prédiction.

DeepSeek V4 : le labo qui dessine les plans des futurs LLM

Les architectes en chef

DeepSeek V4 est le modèle que j’attends le plus en 2026. Pas parce qu’il sera le « meilleur » sur tel ou tel leaderboard ; cette course-là m’intéresse de moins en moins. Ce qui m’intéresse chez DeepSeek, c’est qu’ils sont devenus les architectes en chef de l’ère actuelle des LLM.

Dans un paysage où la plupart des labos scalent en brute-force (plus de données, plus de GPU, plus de paramètres), DeepSeek prend le chemin inverse : comment obtenir le même résultat avec moins ? Et à chaque fois, la réponse passe par une innovation structurelle, pas par un chéquier plus gros.

Soyons précis sur ce que je dis, et ce que je ne dis pas. OpenAI et Anthropic restent les maîtres du contenu : data curation, post-training, alignement. DeepSeek, lui, optimise le contenant, c’est-à-dire l’architecture elle-même.

Avoir les meilleurs plans ne garantit pas le meilleur bâtiment. Mais dans cette industrie, les bons plans finissent toujours par être copiés. Et sur ce terrain, DeepSeek est devenu difficile à ignorer.

Le track record : les plans que le reste de l’industrie copiera

Je ne fais pas confiance à DeepSeek par enthousiasme.

Je leur fais confiance pour une raison plus simple : leurs papiers deviennent des produits.

MoE : Avec V2 puis V3, ils ont montré qu’on pouvait activer seulement 37 milliards de paramètres sur 671 milliards au total, tout en atteignant des performances frontier pour un coût d’entraînement inférieur à 6 millions de dollars. Le MoE existait avant eux. Mais DeepSeek a joué un rôle majeur dans sa réinstallation au centre du jeu frontier. Aujourd’hui, chez Llama 4 Scout, Gemma ou Qwen, le MoE s’est réinstallé au cœur de la course frontier.

MLA : La Multi-head Latent Attention compresse les clés et valeurs dans un espace latent, réduisant drastiquement le KV cache. FlashMLA dépasse les 12 600 stars GitHub en avril 2026. On n’est plus dans une idée théorique : c’est devenu un composant d’infrastructure adopté bien au-delà de l’écosystème DeepSeek.

Multi-Token Prediction (MTP) : Meta avait publié le concept en 2024. DeepSeek l’a mis en production à grande échelle dans V3, avec des modules séquentiels et du speculative decoding. Résultat : des gains d’inférence concrets et mesurables sur des modèles frontier.

DSA : Une attention sparse content-aware : un indexer léger en FP8 scanne les tokens et sélectionne dynamiquement ceux qui méritent une attention dense. Les tokens routiniers passent en mode sparse ; ceux qui demandent du raisonnement profond gardent l’attention pleine. Résultat : contexte traité 3× plus vite, coûts API divisés par deux sur longues séquences, qualité de sortie préservée. DSA est déjà déployé dans V3.2.

Le pattern est toujours le même :

papier → kernels CUDA optimisés → modèle suivant qui intègre.

- MoE → V2

- MLA → V2/V3

- DSA → V3.2

L’écart entre recherche et production se mesure en mois, pas en années. C’est ce pattern qui rend leurs publications importantes à suivre.

Deux pistes qui disent quelque chose de V4

Soyons clairs : rien ne confirme officiellement que ces idées seront dans V4. Pas de technical report à ce jour.

Mais leur timing (janvier 2026), leur nature, et leur cohérence avec les travaux précédents en font des signaux crédibles. Même si elles ne sont pas intégrées, elles disent quelque chose de la direction que DeepSeek veut prendre.

mHC : garder plusieurs chemins sans déformer le message

Le problème. Dans un réseau de neurones très profond, le sujet n’est pas seulement d’empiler plus de couches. Le vrai problème, c’est ce que cette profondeur fragilise pendant l’entraînement.

À chaque étape, le modèle fait deux mouvements inverses. D’abord, le signal circule vers l’avant (forward pass) : les tokens traversent les couches, et chaque couche transforme leur représentation. Ensuite, le gradient remonte vers l’arrière (backpropagation) pour corriger les poids.

Quand le modèle devient très profond, ces deux trajets deviennent fragiles. Le gradient doit traverser toute la profondeur du réseau : il peut s’évanouir, exploser, ou devenir trop bruité pour guider correctement l’apprentissage. Et le signal lui-même se déforme couche après couche. Après cent, deux cents ou trois cents transformations successives, il n’est plus évident que ce qui arrive en bas ressemble encore à une information exploitable.

Le symptôme côté training n’est donc pas simplement que « les couches profondes apprennent mal ». Le problème est plus précis : le passage du signal et du gradient à travers toute la profondeur devient instable. Résultat : convergence plus lente, entraînement plus fragile, voire divergence complète.

La première solution. Les residual connections (ResNet, 2016) ont apporté une idée simple : garder une voie directe pour le signal. Chaque couche ajoute sa contribution au lieu de remplacer complètement le signal précédent. C’est le fameux $y = f(x) + x$ qui a rendu possibles les transformers profonds.

Le nouveau problème. Pour enrichir les représentations, certains modèles, ByteDance en tête avec les Hyper-Connections en 2024, ont introduit plusieurs chemins parallèles. L’idée est bonne : plusieurs flux permettent de transporter différentes « versions » de l’information et réduisent la redondance entre couches. Mais sans contrainte, ces flux se mélangent librement et on perd la stabilité. Les gradients explosent ou s’évanouissent.

L’idée de mHC. Garder plusieurs chemins, mais contraindre leur mélange.

Autrement dit : les flux peuvent coexister et s’enrichir mutuellement, mais ils n’ont pas le droit de se recombiner n’importe comment. À chaque couche, leur interaction est projetée sur une variété (manifold) mathématique, concrètement le Birkhoff polytope via Sinkhorn-Knopp, qui garantit la conservation de l’information totale. L’identity mapping est préservé, même avec plusieurs streams.

Ce n’est donc ni une simple ligne directe, ni un chaos de chemins, mais un réseau multi-voies avec des règles de circulation strictes.

Pourquoi ça compte. À très grande échelle, le problème n’est pas seulement d’ajouter de la capacité. C’est de s’assurer que l’information reste exploitable après des centaines de couches. mHC cherche à obtenir les bénéfices du multi-chemin (plus de diversité, moins de redondance) sans perdre la stabilité fondamentale des residual connections. Le papier, testé jusqu’à 27B paramètres, montre une stabilité d’entraînement exceptionnelle avec un overhead de seulement 6 à 7 %. Et surtout : il est co-signé par Liang Wenfeng, le CEO de DeepSeek. Quand le patron signe un papier d’architecture, ce n’est pas anodin.

Engram : arrêter d’utiliser tout le modèle pour se souvenir d’un fait simple

Le problème. Dans un transformer classique, mémoire et raisonnement sont totalement confondus. Le modèle mobilise toute sa capacité neuronale aussi bien pour rappeler « Paris est la capitale de la France » que pour résoudre un problème de maths en plusieurs étapes. C’est puissant, mais coûteux pour des connaissances statiques.

L’idée. Séparer les deux.

Engram introduit une mémoire statique dédiée, capable de retrouver rapidement des motifs ou connaissances récurrentes, pendant que le réseau neuronal se concentre sur le raisonnement compositionnel.

L’intuition est presque provocatrice en 2026 : on revient aux N-grams (2-gram, 3-gram), mais modernisés. On hash les séquences courtes d’entrée vers des tables d’embeddings géantes, puis on fusionne le résultat avec le hidden state via un gate appris. Lookup en $O(1)$, déterministe, et surtout : les tables peuvent être offloadées sur la RAM CPU au lieu de saturer la VRAM GPU.

Le point clé. Le papier montre une loi d’échelle en U : il existe un équilibre optimal entre mémoire statique (Engram) et computation dynamique (MoE + attention). Trop de mémoire statique et le modèle perd en flexibilité de raisonnement. Trop peu et on gaspille du compute sur du pattern matching trivial.

L’analyse mécanistique est la plus intéressante : Engram « soulage les premières couches de la reconstruction de patterns statiques », ce qui permet de réserver la profondeur effective du modèle à ce que le transformer fait de mieux, le raisonnement multi-étapes. C’est une hypothèse forte, mais elle colle parfaitement à la philosophie DeepSeek.

Les questions qui dérangent

Contenant vs contenu

DeepSeek optimise l’architecture comme peu d’acteurs aujourd’hui. Mais la performance réelle des modèles frontier repose encore massivement sur le post-training, la curation de données et l’alignement. Un plan brillant ne suffit pas sans matériaux de qualité. OpenAI et Anthropic gardent encore une longueur d’avance sur ce terrain.

Chaque gain architectural ferme un peu l’infrastructure

MLA, DSA, mHC, Engram : toutes ces approches nécessitent des kernels CUDA spécialisés. FlashMLA en est la preuve vivante.

À mesure que DeepSeek améliore l’architecture, il réduit aussi la neutralité de l’infrastructure. Chaque gain de performance déplace de la valeur vers une stack d’exécution plus complexe à mettre en ouevre et donc moins accessible. C’est le paradoxe : optimiser la forme du modèle peut compliquer son adoption par le reste de l’écosystème.

Le vrai test : la sparsité tient-elle en raisonnement long ?

C’est peut-être la question la plus profonde. Les modèles sparses sont ultra-efficaces. Mais sont-ils aussi robustes sur :

- les chaînes de pensée très longues,

- le raisonnement multi-étapes complexe,

- la cohérence sur 50k+ tokens ?

Si la sparsité introduit des instabilités à ce niveau, alors le gain d’efficience pourrait se payer exactement là où on attend le plus des modèles frontier.

Ce que dit l’ensemble

Ce qui frappe chez DeepSeek, c’est la cohérence systémique de leurs innovations. Chaque idée adresse une dimension orthogonale du scaling :

- DSA : scaling de l’attention en longueur de contexte

- mHC : stabilité du gradient en profondeur extrême

- Engram : organisation intelligente de la mémoire

- MoE : toile de fond du scaling du compute

Ce n’est pas une collection de hacks indépendants. C’est une tentative de repenser l’architecture à chaque niveau du système. Là où beaucoup raisonnent en « plus de tout », DeepSeek raisonne en : le bon mécanisme au bon endroit.

V4 devrait sortir dans les prochains jours. Les benchmarks me diront s’il court vite. C’est le technical report que j’attends, pour voir s’il change la manière de construire les futurs LLM.

Ressources

Engram

Papier ArXiv : Conditional Memory via Scalable Lookup (2601.07372)

Sépare la mémoire statique ($O(1)$) du raisonnement dynamique.

mHC

Papier ArXiv mHC: Manifold-Constrained Hyper-Connections

Stabilise les gradients sur des modèles à très grande profondeur.

MLA

Code (GitHub) FlashMLA Repository

Kernels CUDA optimisés pour l’attention compressée (KV cache).

DSA

Rapport ArXiv DeepSeek-V3.2: Pushing the Frontier of Open Large Language Models

Indexation FP8 pour une attention “content-aware” ultra-rapide.

V3 / V3.2

Modèle (Poids) DeepSeek-V3.2 on Hugging Face

La base de production actuelle intégrant déjà MLA et DSA.

AiBrain

AiBrain